ControlNet:AI绘画革命,让创作更可控!

ControlNet 是自 WebUI 出现以来最具革命性的扩展插件,它解决了 AI 生图中最棘手的问题——如何让生成过程变得可控。它的原理是通过“预处理器”提取参考图中的结构信息(如姿势、边缘、深度等),再由 ControlNet 模型将这些信息转化为大模型能够理解的条件,从而在生成过程中精确地还原参考特征。这样一来,用户不再只能依赖提示词“碰运气”,而是能用参考图指导 AI,得到符合需求的结果。

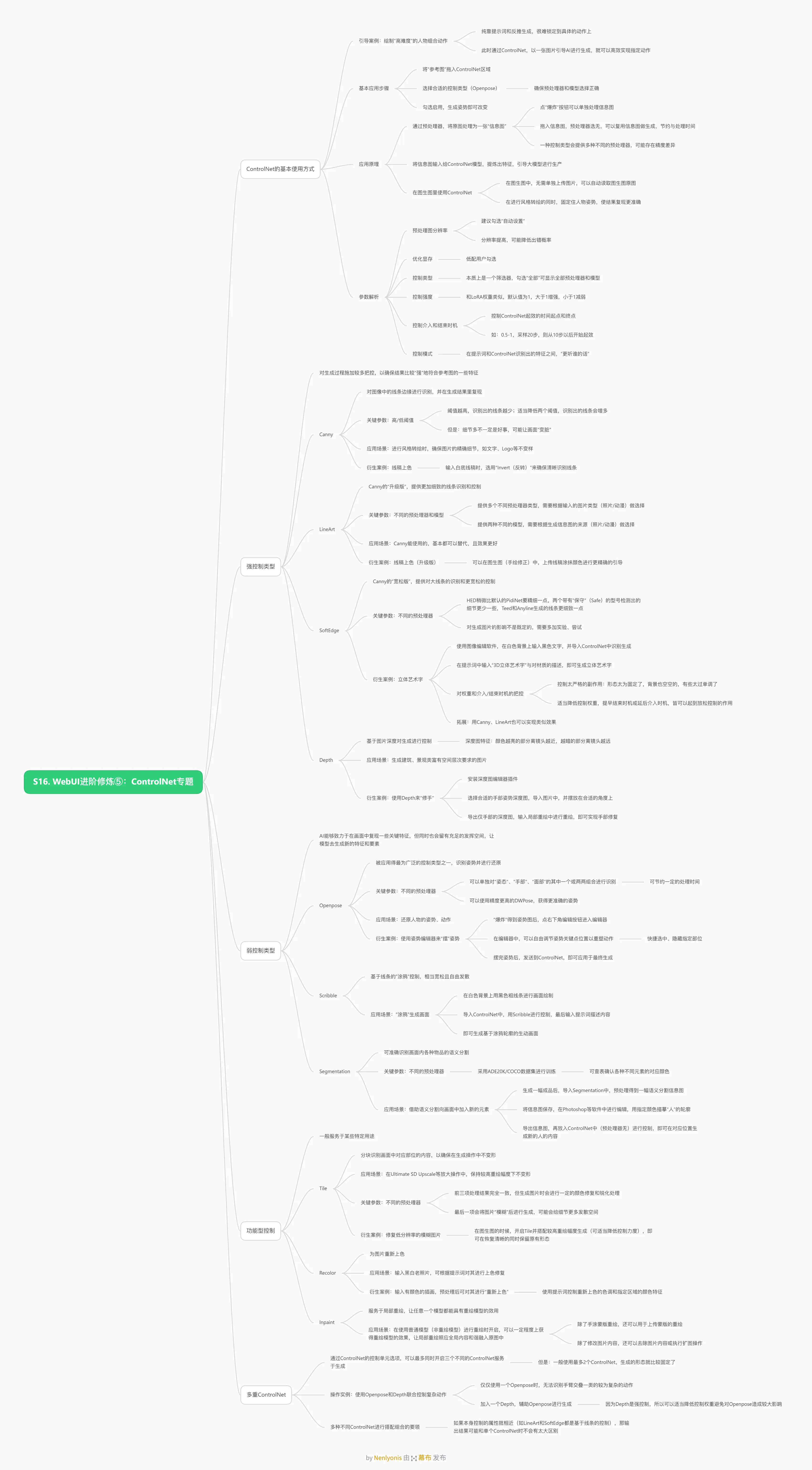

在应用层面,ControlNet 的控制类型大致分为三类:

- 强控制:如 Canny、LineArt、SoftEdge、Depth,它们严格固定图像的结构和轮廓,适合用来复现主体形象、线稿上色、风格转绘或保持画面构图。例如用 Canny 给线稿快速上色,用 Depth 让建筑或景观作品具备真实的空间感,甚至能通过深度图修复人物手势。

- 弱控制:如 OpenPose、Scribble、Segmentation,它们把控更宽松,给模型保留更多发挥空间。OpenPose 能精准复现复杂姿势,并且可通过姿势编辑器手动摆出任意动作;Scribble 则允许用户用随意的涂鸦勾勒大致轮廓,AI 会在此基础上自由生成;Segmentation 通过语义分割让用户能添加或替换画面元素,比如往场景中植入一个新人物。

- 功能型控制:如 Tile、Recolor、Inpaint,它们更像为特定场景准备的“工具包”。Tile 用于保持放大或修复时的全局一致性,避免画面分块错乱;Recolor 可以为黑白照片上色或为现有作品整体换色;Inpaint 则赋予任何模型局部重绘的能力,让修改、去除或扩展画面内容变得自然流畅。

更进一步,ControlNet 还能多重协同使用。在一个生成任务中,用户可以同时启用多达三个 ControlNet 单元,比如用 OpenPose 固定姿势,再用 Depth 辅助空间关系,从而达到单一控制无法实现的效果。这种“叠加控制”极大提升了灵活性,让复杂需求也能得到可靠的结果。

ControlNet模型与预处理器下载

Section titled “ControlNet模型与预处理器下载”模型和预处理器下载地址:https://pan.baidu.com/s/1_qh-wjhIO_ei7Sii6gUMuw?pwd=9kbn

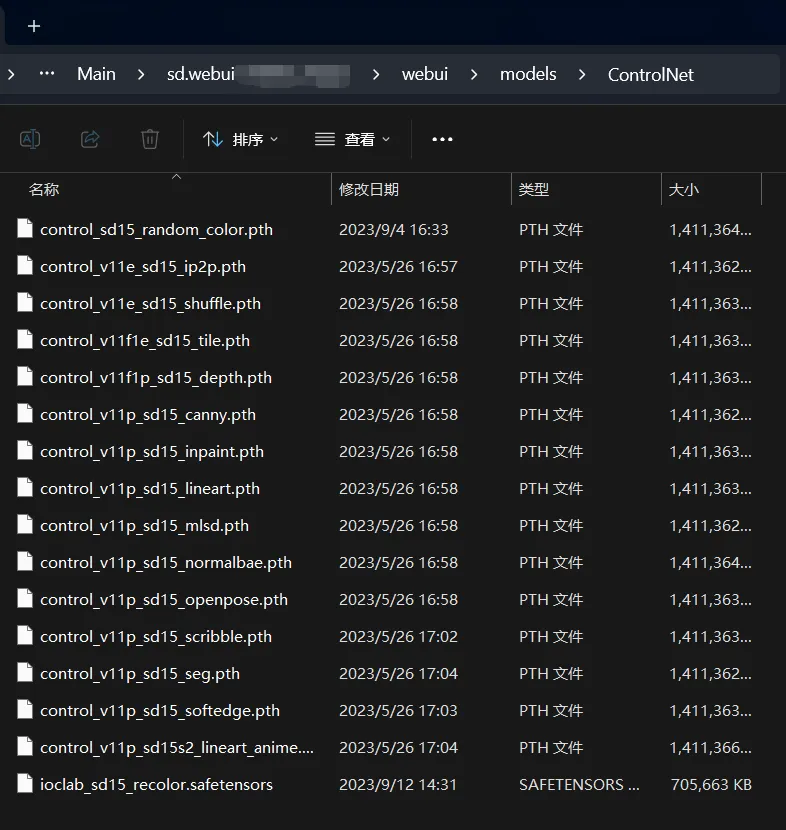

模型放置位置:webui\models\ControlNet

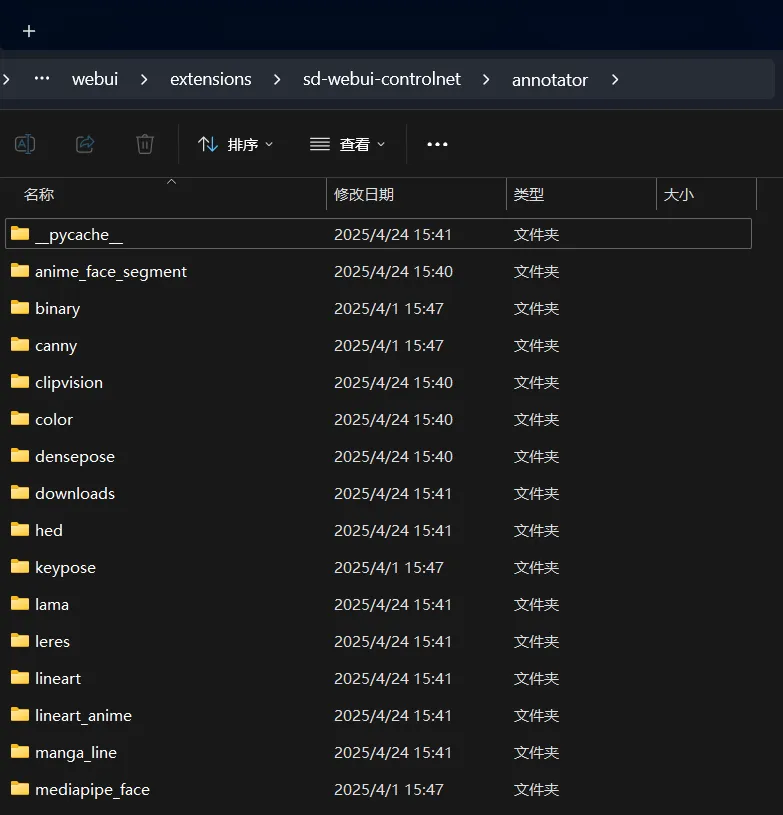

预处理器放置位置:webui\extensions\sd-webui-controlnet\annotator

(解压Annotator.zip,将里面的东西放进文件夹中》

1. 什么是 ControlNet?

Section titled “1. 什么是 ControlNet?”ControlNet 是 Stable Diffusion WebUI 中最受欢迎且最具革命性的扩展插件之一 。

核心作用:解决 AI 生图过程中“难以控制”的痛点。它可以控制人物的指定动作、场景的空间层次,以及在放大修复过程中确保细节不变形 。

解决的问题:传统的提示词很难还原复杂的手势或组合动作(例如“手托着手”或“手指指嘴”),而 ControlNet 可以精准复现参考图的姿态 。

2. 安装与模型准备

Section titled “2. 安装与模型准备”ControlNet 的安装方式与常规插件相同,但能够正常运行的前提是必须配置好对应的模型文件 。

必要文件:需要将预处理模型和控制模型分别放入 WebUI 的指定文件夹中 。

重启:放置好模型后,重启 WebUI,界面下方会出现 ControlNet 的折叠选单 。

3. ControlNet 的核心工作逻辑

Section titled “3. ControlNet 的核心工作逻辑”ControlNet 的工作流程可以概括为:“参考图 预处理器 信息图 ControlNet 模型 生成结果”。

输入参考图:上传一张包含你想要提取特征(如姿势)的图片 。

预处理 (Preprocessor):

- AI 从原图中读取特定信息(如姿势骨架),并生成一张“信息图”(例如黑底彩线的骨架图)。

- 预览功能:点击预处理器旁边的“爆炸”小图标,可以提前预览生成的预处理图 。

- 多种选择:同一种控制类型有不同的预处理器。例如姿态控制中,

dw_openpose比默认的openpose_full精度更高,能识别肢体末梢细节,但耗时更长 。

模型介入:ControlNet 模型处理这张信息图,将其转化为大模型能理解的条件信息,从而指导生成过程 。

4. 基础操作步骤(以姿态控制为例)

Section titled “4. 基础操作步骤(以姿态控制为例)”上传图片:在 ControlNet 选单中,将参考图拖入输入区域 。

启用插件:勾选图片下方的 “启用 (Enable)” 。

选择类型:点击下方的 “姿态 (Pose)” 等控制类型按钮 。

确认配置:

- 预处理器 (Preprocessor):通常会自动匹配,如

openpose_full。 - 模型 (Model):确保选中了对应的模型文件(如以

openpose结尾的文件)。

点击生成:AI 将忽略提示词中的动作描述,直接根据参考图生成相同的姿势 。

5. 关键参数详解

Section titled “5. 关键参数详解”为了精准控制生成效果,需要理解以下参数的作用:

完美像素 (Pixel Perfect):推荐勾选。它会自动将预处理图的分辨率与目标输出分辨率匹配,是最稳妥的选择 。

- 控制权重 (Control Weight):

- 默认值为

1。 - 大于 1 会增强控制效果,小于 1 则弱化控制 。

- 引导介入/终止时机 (Starting/Ending Control Step):

- 控制 ControlNet 在生成过程中生效的时间段(0~1 代表 0%~100% 的采样步数)。

- 例如设置介入时机为

0.5,意味着 ControlNet 从采样的一半进度才开始生效 。 - 控制模式 (Control Mode):

- 决定是更听提示词的话,还是更听 ControlNet 的话 。

- 多数情况下保持 “均衡 (Balanced)” 即可 。

低显存模式 (Low VRAM):如果设备配置较低,建议勾选此选项以确保顺利运行 。

6. 进阶应用技巧

Section titled “6. 进阶应用技巧”文生图 vs. 图生图:

文生图:ControlNet 可以排除原图颜色影响,专注于结构控制(如姿势),允许大幅改变人物和背景特征 。

图生图:ControlNet 用于在风格转换等操作中保持原图的特征(如姿态、构图)不变 。

使用独立的控制图像:在图生图中,勾选 “使用独立的控制图像 (Upload independent control image)“,可以实现“用 A 图做底图重绘,但用 B 图来控制姿势” 。

直接上传预处理图:如果已经有了骨架图(信息图),可以直接上传并将预处理器选为 “无 (None)“,这样可以跳过预处理步骤,节省时间 。

7.知识大纲

Section titled “7.知识大纲”